Has lanzado tu funcionalidad basada en LLM. Los usuarios empiezan a interactuar con ella. Y entonces aparecen las grietas: respuestas incorrectas, datos alucinados, respuestas que no tienen nada que ver con lo que el usuario preguntaba. ¿Te suena?

Esta es la realidad para la mayoría de los equipos que trabajan con grandes modelos de lenguaje. Los modelos en sí se han vuelto increíblemente capaces, pero la capacidad sin evaluación es solo confianza sin evidencia.

Gartner predice que, de aquí a 2026, las organizaciones abandonarán el 60 % de sus proyectos de IA debido a la falta de datos preparados para IA. Esa cifra debería hacerte frenar en seco.

Si te tomas en serio lanzar IA que funcione, la evaluación no es opcional. Es todo el juego. Los fallos de evaluación rara vez se anuncian solos. Un sistema RAG puede mostrar puntuaciones sólidas de relevancia en las respuestas mientras la fidelidad se desploma silenciosamente tras añadir nuevos documentos, generando respuestas que suenan correctas pero apuntan a fuentes equivocadas. Un ajuste de prompt que mejora el tono puede disparar las tasas de alucinación al mismo tiempo, y no te enterarás hasta que los usuarios empiecen a señalar respuestas incorrectas en producción.

¿Qué son las herramientas de evaluación de LLM y por qué importan?

Las herramientas de evaluación de LLM son frameworks y plataformas que miden qué tan bien se desempeña un gran modelo de lenguaje en casos de uso y tareas del mundo real. Van más allá de comprobar si un modelo da la respuesta “correcta” y evalúan aspectos como la precisión factual, la relevancia de la respuesta, la toxicidad, el sesgo, la coherencia y qué tan fielmente un modelo sigue las instrucciones.

Piénsalas como el pipeline de QA para la IA. Así como no lanzarías software sin probarlo, no deberías desplegar una aplicación LLM sin entender dónde falla y bajo qué condiciones.

Esta es la razón por la que esto importa más de lo que la mayoría de los equipos cree:

- Los LLM son probabilísticos. La misma entrada puede producir salidas diferentes en distintas ejecuciones. Sin evaluación, vuelas a ciegas en cuanto a consistencia.

- Alucinan. Sin medir las tasas de alucinación en tu contexto específico, no tienes idea de con qué frecuencia tu modelo se está inventando cosas con total confianza.

- Se degradan. Las actualizaciones de prompts, los cambios de versión del modelo y los datos nuevos pueden romper silenciosamente un rendimiento que antes era sólido.

Las buenas prácticas de testing de LLM son lo que separa un producto de IA pulido de un pasivo. Las herramientas de evaluación hacen que esas prácticas sean repetibles, trazables y escalables. Descubre cómo nuestras Estrategias de Testing y Evaluación de LLM para Aplicaciones de IA de Alta Calidad se combinan con las herramientas de evaluación adecuadas para lanzar IA en la que realmente puedas confiar.

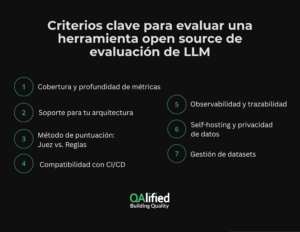

Criterios clave para evaluar una herramienta de evaluación de LLM de código abierto

No todos los frameworks de evaluación están construidos de la misma manera. Antes de comprometerte con uno, ponlo a prueba contra estos criterios:

- Cobertura y profundidad de métricas. Van más allá de comprobar si un modelo da la respuesta “correcta” y miden lo que importa en producción: corrección frente a fuentes verificadas, relevancia de la respuesta, cumplimiento de la tarea, tasa de alucinación, sesgo y toxicidad. Para un análisis más profundo de cómo se miden estos aspectos, consulta nuestra guía sobre Métricas y Técnicas Clave de Evaluación de LLM para Modelos Confiables.

- Soporte para tu arquitectura. ¿Estás construyendo un pipeline RAG? ¿Un agente conversacional? ¿Un sistema de resumen? Algunas herramientas están diseñadas específicamente para la evaluación de RAG. Otras son más generales. Los desajustes aquí hacen perder tiempo.

- LLM-as-a-judge frente a puntuación basada en reglas. Los enfoques de LLM-as-a-judge ofrecen flexibilidad para verificaciones de calidad subjetivas, pero vienen con compromisos de coste y latencia. Las verificaciones basadas en reglas son más rápidas y baratas, pero menos matizadas. Las mejores herramientas te ofrecen ambas.

- Compatibilidad con CI/CD. Una evaluación que solo ocurre manualmente es una evaluación que se termina saltando. Busca herramientas que se integren en tu pipeline de despliegue existente, para que cada check-in de código o merge active una verificación.

- Observabilidad y trazabilidad. ¿Puedes rastrear lo que ocurrió durante una llamada específica al LLM? ¿Puedes ver la cadena completa de prompts, recuperaciones y salidas? Sin esto, depurar los fallos se convierte en adivinar.

- Autoalojamiento y privacidad de datos. Para los equipos con requisitos de cumplimiento, la capacidad de ejecutar evaluaciones on-premise no es negociable. Las herramientas de código abierto que admiten autoalojamiento te dan control total sobre dónde van tus datos.

- Gestión de datasets. ¿Puede la herramienta ayudarte a construir, versionar y gestionar datasets de evaluación a lo largo del tiempo? Esto es lo que convierte evaluaciones puntuales en un ciclo continuo de mejora de la calidad.

Si una herramienta no puede explicar claramente por qué un modelo falló en un caso de prueba específico, no es útil en producción. La mayoría de los equipos dependen en exceso de LLM-as-a-judge e ignoran la calidad del dataset. En la práctica, los datasets de evaluación débiles o desactualizados causan más fallos que la propia elección de la herramienta.

Principales herramientas de evaluación de LLM de código abierto

| Herramienta | Ideal para | Métricas | Soporte RAG | Soporte de agentes | Autoalojable | Lista para CI/CD |

|---|---|---|---|---|---|---|

| DeepEval | Evaluaciones estilo unit-test | Más de 14 métricas | Sí | Sí | Sí | Sí |

| Langfuse | Observabilidad + trazabilidad | LLM-as-judge + personalizadas | Parcial | Sí | Sí | Sí |

| ArtificialQA | QA empresarial para aplicaciones de IA generativa | Más de 17 métricas | Sí | Sí | Sí | Sí |

| RAGAS | Pipelines RAG | Contexto, fidelidad, relevancia | Sí (enfocado) | No | Sí | Sí |

| MLflow | Seguimiento de experimentos | QA, RAG, comparación | Sí | Parcial | Sí | Sí |

| Opik | LLMOps full-stack | LLM-as-judge + guardrails | Sí | Sí | Sí | Sí |

Figura: Tabla comparativa

DeepEval

DeepEval es uno de los frameworks de evaluación de LLM de código abierto más ampliamente adoptados, con más de 400.000 descargas mensuales. Fue construido con una mentalidad developer-first, tratando las evaluaciones como unit tests mediante una integración con Pytest que te permite incrustar verificaciones de evaluación directamente en tu suite de tests existente.

- Características clave y métodos de evaluación: DeepEval viene con más de 14 métricas integradas que cubren evaluación de RAG (precisión contextual, recall, fidelidad, relevancia de la respuesta), evaluación de agentes (cumplimiento de tareas, corrección de herramientas), métricas conversacionales (retención de conocimiento, relevancia por turno) y verificaciones de seguridad (sesgo, toxicidad, alucinación). Sus métricas son autoexplicativas, lo que significa que cuando una puntuación no alcanza el nivel esperado, la herramienta te dice exactamente por qué.

- Casos de uso típicos y fortalezas: Es la opción preferida para equipos que construyen aplicaciones RAG, chatbots y agentes LLM que quieren la evaluación integrada en su pipeline de CI/CD desde el primer día. El diseño modular facilita mezclar y combinar métricas o crear personalizadas para tu dominio.

- Limitaciones: DeepEval se apoya en gran medida en la puntuación con LLM-as-a-judge, lo que añade coste de inferencia y latencia a escala. También está orientado principalmente a desarrolladores y no incluye monitorización en producción ni flujos de trabajo con human-in-the-loop de serie.

Ideal para equipos que quieren la evaluación integrada directamente en pipelines de CI/CD.

Langfuse

Langfuse se ha convertido en una de las plataformas de observabilidad y evaluación de LLM de código abierto más populares, especialmente entre equipos que quieren control total sobre su stack. Es autoalojable, se integra con los principales frameworks de LLM y proporciona trazabilidad de extremo a extremo, desde la entrada hasta la salida.

- Características clave y métodos de evaluación: Langfuse captura automáticamente todos los detalles de una llamada a un LLM, incluidos entradas, salidas, llamadas a APIs y latencia. En el lado de la evaluación, admite métricas de LLM-as-a-judge, flujos de anotación humana, conjuntos de pruebas personalizados y versionado de prompts con un playground integrado. Puedes ejecutar tanto evaluaciones online (producción) como offline (pre-despliegue) desde la misma plataforma.

- Casos de uso típicos y fortalezas: Langfuse es muy adecuado para organizaciones que construyen sus propios pipelines de LLMOps y necesitan visibilidad y transparencia a lo largo de todo el stack. Su opción de autoalojamiento lo convierte en una excelente opción para equipos con requisitos estrictos de residencia de datos o cumplimiento normativo.

- Limitaciones: Configurar el autoalojamiento requiere esfuerzo de DevOps. El soporte de frameworks para herramientas de desarrollo de IA más nuevas es más limitado en comparación con algunas alternativas de código cerrado. Los equipos que necesitan funcionalidades de nivel empresarial como RBAC avanzado o cumplimiento SOC2 pueden necesitar actualizar a los planes de pago.

Ideal para equipos que necesitan visibilidad total del comportamiento del LLM en producción.

ArtificialQA

ArtificialQA es una plataforma de evaluación de extremo a extremo diseñada para equipos de QA que trabajan con sistemas de IA conversacional, posicionada como QA empresarial para aplicaciones de IA generativa. Estructura todo el flujo de testing dentro de proyectos: diseñar casos de prueba, organizarlos en suites, ejecutarlos contra agentes en vivo vía API y evaluar las respuestas con un sistema de puntuación de tres capas.

- Características clave y métodos de evaluación: El motor de evaluación combina aserciones estrictas (regex, coincidencia exacta, esquema JSON, tolerancia numérica) que actúan como filtro previo antes de que se ejecute cualquier puntuación con LLM, junto con más de 17 evaluadores LLM ponderados que cubren alucinación, precisión, cumplimiento, tono y dimensiones específicas de RAG como groundedness y corrección de citas. Cada ejecución captura instantáneas completas para garantizar la reproducibilidad, y las puntuaciones se agregan en un veredicto ponderado de aprobado/reprobado tanto a nivel de caso como de plan.

- Casos de uso típicos y fortalezas: Está construido para equipos que necesitan un ciclo estructurado de QA, no solo un script de puntuación. La gestión del ciclo de vida de los casos de prueba (borrador → aprobado → obsoleto), las conexiones con agentes en múltiples entornos y la exportación de evidencia lo hacen práctico para industrias reguladas donde la auditabilidad importa. Las pruebas de pipelines RAG son nativas, con ingesta de documentos y generación de pruebas directamente desde el corpus de conocimiento.

- Limitaciones: El flujo de trabajo estructurado (proyectos, suites, planes, conexiones) es más de lo que la mayoría de los equipos necesitan para experimentos en etapa temprana. Más adecuado para equipos que ejecutan ciclos de QA repetibles que para evaluaciones ad-hoc.

Ideal para equipos de QA que necesitan un ciclo de vida de testing completo para agentes de IA conversacional, incluidos pipelines RAG.

RAGAS

RAGAS (Retrieval Augmented Generation Assessment) es un toolkit ligero de código abierto construido específicamente para evaluar pipelines RAG. Si tu aplicación involucra recuperación, esta herramienta fue diseñada a medida para tu caso de uso.

- Características clave y métodos de evaluación: RAGAS se centra en cuatro métricas fundamentales: precisión de contexto, recall de contexto, fidelidad y relevancia de la respuesta. Puede combinar la puntuación basada en LLM con métricas clásicas de NLP como BLEU y ROUGE. Una característica destacada es la capacidad de generar datasets de prueba sintéticos a partir de tus documentos, para que puedas empezar a evaluar incluso sin tener un dataset etiquetado listo.

- Casos de uso típicos y fortalezas: RAGAS es el toolkit de evaluación estándar para aplicaciones RAG. Si estás construyendo sobre LangChain, LlamaIndex o frameworks similares, la integración es directa. Es completamente gratuito y de código abierto bajo la licencia MIT.

- Limitaciones: RAGAS tiene un alcance estrecho. Es excelente para RAG, pero no cubre agentes conversacionales, sistemas QA generales ni evaluaciones centradas en seguridad. Para que los equipos construyan cualquier cosa más allá de un pipeline de recuperación, necesita complementarse con herramientas adicionales.

Ideal para aplicaciones RAG donde la calidad de la recuperación impacta directamente en la precisión de la salida.

MLflow

MLflow es el caballo de batalla del seguimiento de experimentos en el mundo del ML, y ha extendido sus capacidades para cubrir la evaluación de LLM. Si tu equipo ya está usando MLflow para machine learning tradicional, añadir evaluaciones de LLM a la misma plataforma es un siguiente paso natural.

- Características clave y métodos de evaluación: El módulo de evaluación de LLM de MLflow admite auto-tracing para los principales frameworks, incluidos OpenAI, LangChain, LlamaIndex, DSPy y AutoGen. Gestiona la evaluación de question-answering, la evaluación de RAG y la comparación de modelos con métricas integradas. Cada ejecución se registra con hiperparámetros, versiones de prompts y resultados de métricas.

- Casos de uso típicos y fortalezas: MLflow destaca para equipos que quieren una plataforma unificada tanto para flujos de ML tradicional como de LLM. Su registro de modelos y el seguimiento reproducible de experimentos lo hacen particularmente fuerte para equipos que necesitan gestionar múltiples versiones de modelos.

- Limitaciones: MLflow no fue diseñado originalmente para LLM, y eso se nota. Carece de funcionalidades nativas de LLM como monitorización en tiempo real, trazado conversacional o detección avanzada de alucinaciones. Para equipos que construyen productos LLM-first, a menudo necesita combinarse con una herramienta de evaluación más especializada.

Ideal para equipos que ya gestionan experimentos de ML y quieren extenderse a la evaluación de LLM.

Opik

Opik es una plataforma de evaluación y observabilidad de LLM de código abierto construida para el testing de extremo a extremo de aplicaciones de IA. Extiende la herencia de seguimiento de experimentos de Comet con capacidades de evaluación específicas para LLM.

- Características clave y métodos de evaluación: Opik registra trazas detalladas de cada llamada a un LLM, admite métricas automatizadas de LLM-as-a-judge para factualidad y toxicidad, e incluye guardrails para la seguridad en producción, como la redacción de PII y el bloqueo de temas. Se integra con pipelines de CI/CD y admite tanto evaluación de RAG como evaluación de agentes multi-turno.

- Casos de uso típicos y fortalezas: Opik es una opción sólida para equipos de ciencia de datos y ML que ya están en el ecosistema Comet y quieren extender su seguimiento de experimentos existente para cubrir flujos de LLM. Su enfoque full-stack, desde el trazado hasta la evaluación y los guardrails, significa que no necesitas hacer malabares con múltiples herramientas.

- Limitaciones: Opik está orientado a desarrolladores y construido principalmente para CI/CD y benchmarking. Tiene menos soporte para flujos de anotación colaborativos con múltiples partes interesadas. Los despliegues de código abierto también requieren un esfuerzo continuo de mantenimiento para equipos sin recursos dedicados de DevOps.

Si estás construyendo una aplicación RAG, empieza con RAGAS y combínalo con Langfuse u Opik para la trazabilidad.

Si necesitas un punto de partida sencillo, usa DeepEval para la validación en CI/CD, RAGAS para la evaluación de recuperación y Langfuse para la monitorización en producción.

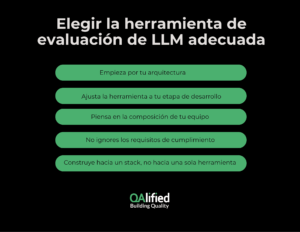

¿Cómo elegir la herramienta de evaluación de LLM adecuada para tu caso de uso?

Aquí está la respuesta honesta: no hay una sola herramienta que lo haga todo bien. Los equipos que aciertan con esto eligen herramientas que coinciden con su arquitectura, con el flujo de trabajo de su equipo y con el punto en el que se encuentran en el ciclo de vida del desarrollo.

- Empieza por tu arquitectura. Si estás construyendo una aplicación RAG, RAGAS debería ser tu primera parada para obtener métricas específicas del pipeline. Combínalo con Langfuse u Opik para una trazabilidad completa y tendrás una base sólida.

- Ajusta la herramienta a tu etapa de desarrollo. Al principio del desarrollo, el enfoque estilo unit-test de DeepEval te ayuda a detectar regresiones rápidamente. A medida que te mueves hacia producción, querrás herramientas de observabilidad como Langfuse u Opik para monitorizar el comportamiento en vivo.

- Piensa en la composición de tu equipo. Si tu equipo está formado mayoritariamente por ingenieros que viven en la terminal, DeepEval y RAGAS te resultarán naturales. Si tienes product managers o expertos de dominio que necesitan revisar y anotar las salidas, busca herramientas con interfaces accesibles y flujos de anotación humana.

- No ignores los requisitos de cumplimiento. Si estás en salud, finanzas o cualquier industria regulada, la capacidad de autoalojar tu infraestructura de evaluación es un requisito básico, no un extra. Tanto Langfuse como Opik lo soportan bien.

- Construye hacia un stack, no hacia una sola herramienta. Los equipos más efectivos combinan una herramienta de benchmarking para la selección de modelos previa al despliegue, un framework a nivel de aplicación para la evaluación en CI/CD y una plataforma de observabilidad para la monitorización en producción. Cada capa captura distintos modos de fallo.

La pregunta clave que debes hacerte antes de comprometerte con cualquier herramienta: ¿Puede decirme, específicamente, por qué mi modelo falló en ese caso de prueba? Si la respuesta es sí, estás en el lugar correcto.

Conclusión

La verdadera pregunta no es si tu modelo fallará. Fallará. La pregunta es si lo verás venir.

La mayoría de los equipos se entera de que algo está roto cuando un usuario se lo dice. Para entonces, el daño ya está hecho, y estás depurando en producción con consecuencias reales en juego.

La configuración de evaluación adecuada te da tres cosas antes de que eso ocurra: visibilidad sobre dónde tu modelo tiene dificultades, verificaciones de consistencia en cada cambio de prompt o de modelo, y suficiente confianza en lo que lanzas como para respaldarlo.

¿Listo para pasar de la teoría de la evaluación a una configuración que aguante en producción?

Descubre cómo nuestros Servicios de Consultoría de QA pueden ayudarte a diseñar, implementar y escalar una estrategia robusta de evaluación de LLM.