¿Buscas una experiencia más amplia en QA? Conoce nuestros Servicios de Consultoría en QA, donde nuestros especialistas ayudan a las organizaciones a fortalecer su estrategia global de calidad de software.

Los modelos de lenguaje de gran tamaño (LLM) se están integrando rápidamente en los sistemas de software modernos. Desde asistentes de atención al cliente hasta herramientas empresariales, están transformando la forma en que las aplicaciones interactúan con los usuarios y generan información. A medida que las organizaciones adoptan IA generativa a gran escala, garantizar la calidad de estos sistemas se vuelve un desafío clave.

Las prácticas tradicionales de QA fueron diseñadas para sistemas determinísticos, donde la misma entrada siempre produce la misma salida. Las aplicaciones basadas en LLM se comportan de manera diferente. Sus respuestas pueden variar, lo que hace que la validación de la calidad sea más compleja y requiera nuevas estrategias de testing.

El panorama del software es más dinámico que nunca. Los Large Language Models (LLM) ya no son una curiosidad utilizada solo para investigación y experimentación; hoy están presentes en chatbots de atención al cliente, motores de búsqueda e incluso asistentes de programación. En 2025, el 67% de las organizaciones a nivel mundial utiliza LLMs para apoyar sus operaciones con inteligencia artificial generativa.

A medida que estas tecnologías continúan adoptándose y desempeñan un papel cada vez más importante en los procesos de negocio, es fundamental que nuestro enfoque hacia la calidad también evolucione. Para un equipo de QA, esto significa que es momento de pensar el testing de una manera diferente.

El estado actual del testing y la validación fue diseñado para un mundo en el que una entrada determinada siempre producía un resultado predecible. Este no es el caso de los LLMs, donde un mismo prompt puede generar resultados distintos cada vez que se ejecuta. Esto plantea un problema que requiere nuevas soluciones, por lo que el testing de LLM se está convirtiendo en una habilidad esencial para los equipos modernos de QA.

¿Qué es el testing de LLM?

El testing de LLM es el proceso de validar las respuestas generadas por un modelo en relación con criterios como precisión, relevancia, equidad, entre otros, dependiendo del caso de uso específico.

Los LLMs no producen resultados idénticos ante prompts idénticos. Esto significa que el testing no busca encontrar una respuesta “correcta” o “incorrecta”, sino evaluar la calidad de la respuesta.

Generalmente, el testing busca identificar:

- Alucinaciones o hechos inventados

- Precisión

- Equidad y ausencia de contenido tóxico

- Cumplimiento de los requisitos del negocio

El rol del QA cambia: ya no se trata solo de validar respuestas generadas por el sistema, sino de validarlas en relación con métricas y estándares definidos.

El testing de LLMs implica dos pasos fundamentales:

- Diseñar escenarios representativos

- Evaluar resultados a gran escala

Para ello, los equipos de QA utilizan:

- Bibliotecas de prompts que simulan entradas reales de usuarios

- Funciones de evaluación para puntuar las respuestas generadas

- Bucles de retroalimentación automatizados para detectar regresiones

Un ejemplo simple: se evalúa un LLM de soporte al cliente alimentándolo con 100 tickets reales y puntuando sus respuestas según criterios como exactitud factual y tono. Si el 90% de las respuestas cumple los umbrales definidos, la prueba se considera exitosa.

Herramientas de evaluación de LLM como DeepEval y Langfuse permiten a los equipos integrar verificaciones automáticas en pipelines de CI/CD, garantizando que las actualizaciones del modelo se validen antes de su lanzamiento.

Frameworks enfocados en la validación de la calidad de respuestas de IA, como Artificial QA, ofrecen enfoques estructurados para probar alucinaciones, confiabilidad y seguridad en sistemas de IA generativa.

Si la calidad es esencial, el siguiente paso es comprender cómo se mide. Aquí es donde la distinción entre testing y evaluación se vuelve importante.

Testing de LLM vs Evaluación de LLM: diferencias clave y roles complementarios

| Aspecto | Evaluación de LLM | Testing de LLM |

| Propósito | Medir la capacidad general de un modelo | Verificar que el modelo funcione correctamente en una aplicación específica |

| Enfoque | Rendimiento general y capacidad de razonamiento | Comportamiento en escenarios reales y casos de uso del negocio |

| Método típico | Benchmarks y conjuntos de datos estandarizados | Casos de prueba, prompts y escenarios de validación |

| Métricas | Puntuaciones numéricas (exactitud, resultados en benchmarks) | Resultados de aprobado/reprobado según el comportamiento esperado |

| Ejemplo | Un modelo obtiene 86 % en MMLU | Probar si un chatbot evita dar asesoramiento financiero |

| Cuándo se utiliza | Selección y comparación de modelos | Antes del despliegue y en validaciones continuas |

| Pregunta clave | “¿Qué tan bueno es este modelo en general?” | “¿Es este modelo seguro y confiable para nuestro caso de uso?” |

Es fácil confundir testing de LLM con evaluación de LLM, ya que ambos implican medir la calidad del modelo. Sin embargo, tienen aplicaciones diferentes, y comprender esta distinción ayuda a evitar vacíos en la cobertura.

La evaluación de LLM mide la capacidad general del modelo. Analiza qué tan bien se desempeña en datasets o benchmarks estandarizados.

El resultado suele ser una puntuación numérica que representa precisión, capacidad de razonamiento o comprensión del lenguaje. Por ejemplo, un modelo puede obtener 86% en un benchmark como MMLU.

Esto es útil para comparar modelos y determinar cuál funciona mejor para tareas generales.

La evaluación responde a la pregunta:

“¿Qué tan bueno es este modelo en términos generales?”

Por otro lado, el testing de LLM es más aplicado y específico del contexto. Analiza cómo se comportará el modelo en escenarios concretos relacionados con tu producto.

Los resultados suelen ser aprobado o reprobado, según expectativas definidas.

Por ejemplo:

- Verificar si un chatbot de atención al cliente evita dar asesoramiento financiero

- Verificar si cita correctamente documentación interna

El testing responde a la pregunta:

“¿Es este modelo seguro y confiable para nuestro caso de uso?”

En proyectos reales, ambos son necesarios.

- La evaluación ayuda a elegir un modelo competente en las primeras etapas.

- El testing asegura que el modelo funcione correctamente dentro de la aplicación.

Uno evalúa potencial.

El otro evalúa preparación para producción.

Juntos permiten un enfoque equilibrado y responsable para el desarrollo de sistemas basados en LLM.

Una vez clara esta diferencia, surge la siguiente pregunta práctica: ¿cómo testear LLMs de forma efectiva en sistemas reales?

Tipos de estrategias de testing para LLM

Una buena estrategia de QA combina varios tipos de testing, ya que ninguno por sí solo puede cubrir todos los riesgos asociados al uso de LLMs.

Cada nivel de testing apunta a un tipo distinto de problema, desde la corrección básica hasta la seguridad y la confiabilidad a largo plazo.

Así es como los equipos efectivos organizan su plan de testing.

-

Testing unitario y funcional

Comienza con pruebas pequeñas y específicas.

El testing unitario analiza cómo se comporta el modelo frente a una sola entrada.

Por ejemplo, se puede comprobar si el modelo:

- Incluye el nombre correcto de la empresa en un resumen

- No agrega afirmaciones sin respaldo

El testing funcional va un paso más allá y evalúa el modelo en tareas más completas, como responder consultas de clientes.

-

Testing de regresión

El testing de regresión monitorea el rendimiento del modelo frente a una línea base a lo largo del tiempo.

Esto es fundamental porque los modelos pueden cambiar su comportamiento tras:

- Fine-tuning

- Reentrenamiento

- Cambios en prompts

Sin una línea base, pequeñas degradaciones de calidad pueden pasar desapercibidas.

Comparar resultados nuevos con anteriores permite identificar cuándo el rendimiento disminuye.

Definir umbrales —por ejemplo, mantener la precisión por encima del 85%— ayuda a detectar problemas temprano y mantener la estabilidad del sistema.

-

Testing de responsabilidad y ética

Para sistemas en producción, es necesario evaluar comportamientos dañinos.

Esto incluye pruebas para detectar:

- Toxicidad

- Sesgos de género o raza

- Estereotipos

- Respuestas peligrosas

Los modelos entrenados con grandes datasets de internet pueden reflejar sesgos sociales existentes.

Usar datasets estructurados como HELM o Real Toxicity Prompts ayuda a simular riesgos del mundo real.

-

Testing de rendimiento y seguridad

Los LLMs consumen muchos recursos y pueden ser objeto de abuso.

El testing de rendimiento mide:

- Tiempo de respuesta

- Uso de memoria

- Costos bajo carga real

El testing de seguridad analiza el sistema frente a:

- Prompt injection

- Intentos de jailbreak

- Filtración de información

Las simulaciones de ataque ayudan a identificar vulnerabilidades antes del despliegue.

-

Evaluación de sistemas RAG

En sistemas Retrieval-Augmented Generation (RAG), se deben probar tanto los procesos de recuperación de información como de generación de respuestas.

El sistema debe:

- Recuperar información relevante y confiable

- Generar respuestas basadas en esa información

Entre las métricas utilizadas se encuentran:

- Faithfulness (fidelidad a las fuentes)

- Precisión en las citas

-

LLM como evaluador (LLM-as-a-Judge)

En aplicaciones abiertas, como generación de contenido o tutoría, las pruebas basadas en reglas pueden no ser suficientes.

En estos casos, otro modelo de lenguaje puede actuar como evaluador, analizando las respuestas según criterios como:

- Claridad

- Utilidad

- Tono

- Creatividad

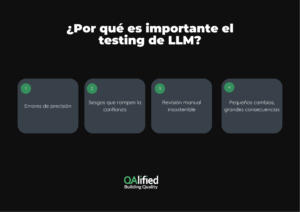

¿Por qué es importante el testing de LLM para QA y la IA empresarial?

El desafío para los equipos de QA está creciendo rápidamente.

Según McKinsey (2025), más del 40% de los líderes empresariales planea integrar LLMs en sus procesos centrales de negocio.

Estas tecnologías ya no son proyectos experimentales. Hoy influyen en conversaciones con clientes, decisiones de negocio y desarrollo de productos.

En la práctica, esto implica varios riesgos.

-

Los errores de precisión representan riesgos reales: Incluso los modelos avanzados pueden generar información incorrecta entre un 3 % y un 10 % de las veces. En sectores regulados como finanzas, salud o derecho, incluso pequeños errores pueden tener consecuencias graves.

-

El sesgo puede socavar la confianza: Si un modelo refleja estereotipos o prejuicios, los usuarios lo notarán. En áreas como contratación o concesión de créditos, las respuestas sesgadas pueden generar problemas de cumplimiento normativo y dañar la reputación.

-

La revisión manual no escala: Aunque los equipos de QA pueden revisar manualmente decenas de respuestas, esto se vuelve imposible cuando los sistemas gestionan miles de interacciones al día.

-

Pequeñas actualizaciones pueden tener grandes impactos: Cambios menores en los prompts pueden afectar de forma inesperada el tono, la precisión o el cumplimiento, e incluso eliminar elementos críticos como los descargos de responsabilidad obligatorios.

Reflexiones finales sobre el testing de LLM

La IA ya no es experimental.

Hoy forma parte del stack tecnológico central de las organizaciones y debe validarse como cualquier sistema crítico.

El testing de LLM brinda a los equipos de QA una forma estructurada de gestionar esta complejidad.

Al aplicar técnicas como:

- testing de regresión

- evaluación RAG

- LLM-as-a-judge

Las organizaciones reemplazan la intuición por validación medible.

Así es como los equipos maduros gestionan la IA hoy.

Cuando los sistemas de IA influyen en decisiones de clientes, cumplimiento normativo y procesos operativos, la calidad se convierte en una responsabilidad de negocio, no solo técnica.

Si los LLM impulsan tus sistemas centrales, el testing no es opcional.

La IA sin validar introduce riesgos operativos y reputacionales.

Conéctate con QAlified para diseñar e implementar una estrategia escalable de testing de LLM que proteja tu marca, reduzca riesgos y garantice un rendimiento confiable de la IA en cada release.

Preguntas frecuentes sobre testing de LLM

1. ¿Cómo se testea un modelo LLM?

Testear un LLM implica definir qué significa “buen rendimiento” para tu aplicación.

Esto incluye:

- Diseñar prompts de prueba realistas

- Evaluar las respuestas en términos de precisión y seguridad

- Comparar los resultados con criterios definidos

El testing automatizado es preferible, pero los casos límite suelen evaluarse manualmente para detectar problemas más sutiles.

2. ¿Qué herramientas se utilizan para testear LLM?

Algunas herramientas comunes incluyen:

- DeepEval para testing automatizado

- Langfuse para monitoreo y trazabilidad

- RAGAs para evaluar sistemas de recuperación de información

Los equipos también desarrollan scripts personalizados para analizar resultados.

La elección depende de si se busca evaluar precisión, seguridad, rendimiento o confiabilidad.

3. ¿Cómo se testean los resultados de un LLM?

Los resultados pueden compararse con estándares de calidad específicos, como:

- precisión

- tono

- completitud

Se pueden usar sistemas de scoring para medir consistencia a lo largo de múltiples prompts.

Probar tanto casos comunes como casos límite ayuda a asegurar que el LLM funcione correctamente en escenarios reales.

4. ¿Cómo se realiza el testing unitario de una aplicación con LLM?

El testing unitario consiste en evaluar la respuesta del modelo frente a un prompt específico.

Por ejemplo, se puede verificar que la respuesta:

- incluya información esencial

- no proporcione sugerencias peligrosas

La prueba se ejecuta varias veces para garantizar consistencia y verificar que el resultado cumpla con los estándares de calidad definidos.